Gefangen im Kaninchenbau

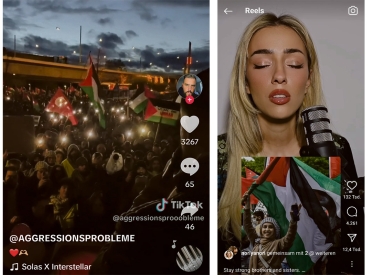

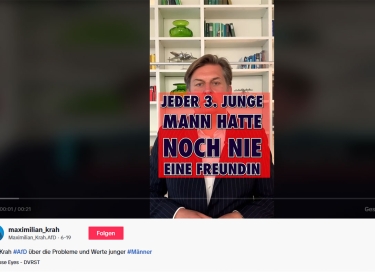

Am Anfang stand TikTok für dämliche Tänzchen, lustige prank-Videos und bizarre lifehack-Tutorials. Wer die App kennt und sie heutzutage regelmäßig nutzt, weiß: Das ist nicht mehr so. Tänzchen und lifehacks sind zwar noch da, aber TikTok hat die Welt der sozialen Medien auf den Kopf gestellt.

Die Rede ist von einer Social-Media-Plattform, die im Jahr 2016 online ging und nach Angaben von Statista Market Insights von 2019 bis 2023 das am schnellsten wachsende soziale Medium war: Die App erreichte in diesem Zeitraum 1,92 Milliarden Nutzer weltweit – was einem Zuwachs von 202 Prozent entspricht. Zum Vergleich: Im selben Zeitraum stiegen die Nutzerzahlen von Facebook (2,72 Milliarden im Jahr 2023) um 36 Prozent und die von Instagram (1,33 Milliarden im Jahr 2023) um 53 Prozent.

»Du sagst TikTok nicht, was du sehen willst. TikTok sagt es dir.«

Drew Harwell, Journalist

Angesichts dieser Zahlen ist es kaum verwunderlich, dass TikTok zum wirtschaftlichen, kulturellen und gesellschaftlichen Phänomen geworden ist, mit dem sich früher oder später auch Staaten und Institutionen beschäftigen mussten. TikTok ist im Hinblick auf Nutzerverhalten, Datensicherheit, Desinformation und sogar Spionage zum Politikum geworden, wie der Umgang der USA und der EU mit der Plattform zeigt.

Die Europäische Kommission hat im Februar ein förmliches Verfahren eingeleitet, um zu prüfen, ob TikTok gegen das Gesetz über digitale Dienste (DSA) in den Bereichen Jugendschutz, Werbetransparenz, Datenzugang für Forscher sowie Risikomanagement für süchtig machendes Design und schädliche Inhalte verstoßen hat.

Noch kein Abonnement?

Um diesen Inhalt zu lesen, wird ein Online-Abo benötigt::